Wenn es gelingt, diese komplexen Strukturen zu vernetzen, ist Advanced Analytics nicht nur ein entscheidender Baustein in der Digitalisierungsstrategie eines jeden Unternehmens,sondern auch ein lukratives Investment.

Wie Einkäufer:innen Advanced Analytics nutzen können

Die Digitalisierung und neue Technologien haben unser privates und berufliches Leben und Handeln in den letzten fünf Jahren stark verändert. Diese Trends spüren Unternehmen nicht nur an veränderten Nachfragemustern bei Konsumenten, sondern auch über die ganze Lieferkette.

Viele Unternehmen befinden sich gerade in einem Wettrennen um Kunden einerseits und Rohstoffe andererseits und investieren immer mehr Geld in Digitaltransformationen. Viele Digitalisierungsvorhaben scheitern allerdings an fehlendem Fachverständnis und dem richtigen Fokus. Dabei gibt es längst eine ganze Reihe an Tools, welche die Arbeit für jede:n Mitarbeiter:in effizienter und effektiver gestalten können. Auch im Einkauf können und sollten sich Unternehmen digitale Tools und Methoden wie Advanced Analytics, E-Sourcing, Künstliche Intelligenz & Machine Learning zu Nutze machen. >

Kompetenzprofile

Manchmal hatten die Köpfe hinter den großen Science Fiction Geschichten schon eine gute Vorstellung davon, wie die Zukunft aussehen könnte. So etwa diejenigen, die die Kommandobrücke des legendären Raumschiffs Enterprise designten: große Bildschirme an den Wänden, davor Schaltflächen, mit denen sich der gesamte Sternenkreuzer steuern lässt. Ähnliche Kontrollräume könnten sehr bald Realität in den Büros von Supply Chain Leiter:innen und Einkäufer:innen sein – weitaus früher als im Jahr 2200.

Digitale Reife der Organisation

Der wichtige erste Schritt ist, die Erwartungen an die Digitalisierung zu definieren, denn diese sind oftmals breit gefächert. Machine Learning, Künstliche Intelligenz und Blockchain können in Zukunft sicherlich helfe. Oft sind diese Konzepte noch sehr abstrakt und müssen auf den Unternehmenszweck und die Bedürfnisse konkretisiert werden.

Zunächst sollten die Verantwortlichen den Digitalisierungsprozess entmystifizieren. Meist geht es nicht darum, jeden einzelnen Prozess in einer Firma disruptiv auf den Kopf zu stellen, sondern einige Abläufe so anzupassen, dass sie effektiver werden. Statt sofort auf eine Blockchain Lösung zu setzen, können zum Beispiel Themen wie E-Sourcing, Process Performance oder eben Advanced Analytics sinnvolle erste Schritte sein. Wer konkrete und realistische Erwartungen formuliert, nimmt sich selbst den Druck und den Mitarbeitern die Skepsis.

Digitalisierung funktioniert nicht nach dem Prinzip „one size fits all“. Jedes Unternehmen ist anders aufgebaut. Eine individuelle Roadmap für den Digitalisierungsprozess sollte dem Rechnung tragen.

Daneben sollten auch die vorhandenen Entscheidungsprozesse Berücksichtigung finden. Sobald die Roadmap definiert ist, geht es darum, die relevanten Prozesse transparent zu machen und mit Hilfe von Tools gezielt zu digitalisieren. Grundlage ist eine agile und abteilungsübergreifende Arbeitsweise. Konzepte wie SCRUM sind hilfreich, sollten aber durch entsprechende Trainings oder Expert:innen erst einmal vermittelt werden.

Erst wenn die „Organizational Readiness“ gegeben ist, macht es Sinn, konkrete Maßnahmen anzugehen. Denn gerade Projekte im Bereich Advanced Analytics erfordern einen grundlegenden Paradigmenwechsel im Einkauf. Es geht nicht darum, nur deskriptive, rückwärtsgerichtete Datenanalysen zu erstellen, sondern die Modellierung zukünftiger Ereignisse und Szenarien zu ermöglichen, wie zum Beispiel Predictive Analytics, Digital Twins, Simulationen.

Advanced Analytics im Einkauf

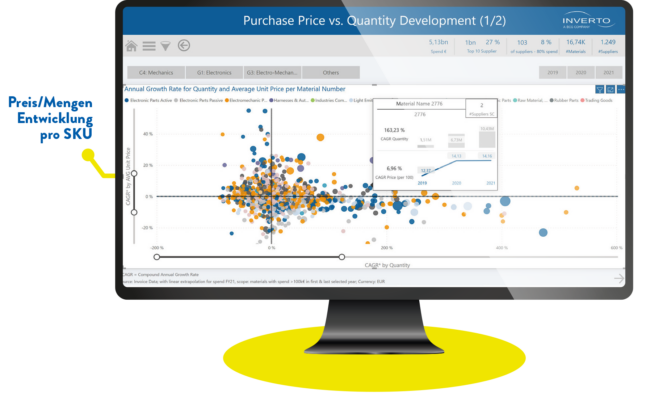

Besonders im Einkauf verspricht Advanced Analytics große Effizienzgewinne. Die Einsatzmöglichkeiten sind vielfältig. Von der reinen Visualisierung durch individuelle Dashboards über die Analyse von Trends bis hin zur Simulation von Zukunftsszenarien ist vieles möglich. Zunächst aber steht die Datenextraktion an. Dabei geht es nicht darum, tief in die Datenbanken einzusteigen und nach versteckten Daten zu suchen. Stattdessen sollten sich alle Beteiligten darum bemühen, bei der Schaffung von Transparenz mitzuwirken – von der Identifizierung von relevanten Datenquellen, deren Speicherort bis zu Verknüpfungsmöglichkeiten.

Auf Basis dieser Daten und der zu erreichenden Ziele können im Anschluss konkret die gewünschten Analysen definiert werden. Je nach Ziel können dies zum Beispiel die Preise im Saisonvergleich, die Logistikkosten pro Kilometer und externe Indizes wie Rohstoffpreise oder Währungsschwankungen, die sich indirekt auf das eigene Geschäft auswirken, sein. Die zusammengetragenen Daten müssen dann einen sogenannten „Sanity Check“ durchlaufen: Fehlerhafte Datenpunkte, die das Analyseergebnis verzerren könnten, werden dabei aussortiert.

So etwas kommt immer wieder vor, gerade wenn Datensätze manuell aktualisiert werden. Das führt zu vielen Fehlern, etwa dass bei Preisen z. B. eine Null zu viel im Dokument auftaucht. Mit den bereinigten Daten startet dann die eigentliche Analyse. Für diese ist es wichtig, klare Ziele festzulegen, denn Analysen um der Analyse willen sind nicht erfolgsversprechend.

Das Beispiel eines großen deutschen Getriebeherstellers zeigt, welches Potenzial in Advanced Analytics schlummert: Das Unternehmen hatte lange Jahre eine sehr fragmentierte Herangehensweise an Datenanalysen im Einkauf. Jede Abteilung arbeitete jeweils mit ihren eigenen Analysetools und unterschiedlichen Datengrundlagen, was eine konsolidierte Betrachtung und damit tiefergehende Analysen verhinderte.

Mit wenigen, aber effektiven Maßnahmen konnten wir aus den vorhandenen Daten zehn einkaufsrelevante Dashboards bauen, die verschiedene Aspekte beleuchten. So visualisieren diese Dashboards zum Beispiel Wechselkursschwankungen und helfen dabei, mögliche Umsatzvorteile für die Lieferanten aufzudecken, um diese Erkenntnisse in Verhandlungen nutzen zu können. Auch Should-Costing-Analysen zählen zu der neuen Toolbox des Unternehmens: Mithilfe eigener und externer Daten lässt sich präzise bewerten, welcher Preis für dieses Produkt angemessen wäre und was demgegenüber der Zulieferer verlangt.

- 1. Einkaufspreis vs. Mengenentwicklung

- 2. Lieferantenwettbewerb bei der Materialanzahl

- 3. Bestpreis-Potenzial

- 4. ...

Die Datengrundlage für diese sehr umfassende Toolbox war dabei keineswegs komplex. Das Unternehmen benötigte dafür nur die Bestelldaten der vergangenen drei Jahre, ergänzt um Informationen des Rechnungswesens. Dazu kommen Daten aus öffentlich zugänglichen Quellen, wie etwa Wechselkurse. Die Toolbox können die Mitarbeiter:innen dabei ohne weiteres mit neuen Datensätzen updaten, so dass die erstellten Analysen stets zeitgemäß bleiben. Auch optische Anpassungen der Dashboards sind ohne tiefgreifendes IT-Know-how möglich. Durch die Toolbox ist es dem Unternehmen gelungen, aus vorhandenen Unternehmensdaten kombiniert mit externen Quellen das volle Potenzial von Einkaufsdaten auszuschöpfen und entscheidungsunterstützende Erkenntnisse zu gewinnen.

Im Folgenden zeigen wir konkrete, nutzenbringende Use Cases, an denen sich Firmen orientieren können:

Anhand eines Spend Cubes können Unternehmen ihre gesamte Ausgabenstruktur analysieren und Potenziale identifizieren. Zusätzlich zu Bestellungen und Rechnungen speisen Firmen auch externe Datenquellen wie Materialpreise ein. Die dahinterliegenden Analysetools arbeiten deutlich schneller, als es ein:e menschliche:r Mitarbeiter:in könnte, Millionen von Dateien können problemlos verarbeitet werden.

Der Überblick ist zum Beispiel auch hilfreich, wenn es um Bestellzeitpunkte geht: Sind bestimmte Materialien im Frühjahr günstiger als im Herbst? Lohnt es sich vielleicht, früher zu kaufen und länger zu lagern? Welche Zulieferer verlangen höhere Preise? Lassen sich diese Unterschiede mit Materialkosten erklären? Die Verantwortlichen im Einkauf steuern mithilfe solcher Spend Cubes nicht nur das Einkaufsverhalten der eigenen Organisation effizienter, sondern haben auch fundierte Datengrundlagen für die Verhandlungen mit den Zulieferern.

Bei der Lagerbestandsoptimierung erweitern Unternehmen die Ausgaben-Daten noch um eine weitere Dimension: Inventarlisten und Verkaufszahlen. Egal ob in der Lagerhaltung, der Vorproduktion oder im Endkundengeschäft: Manche Teile und Produkte bleiben länger im Regal als andere. Der Einkauf kann so identifizieren, wo besondere Nachfrage besteht und entsprechend justieren. Denn warum einen „Ladenhüter“ weiter im selben Ausmaß bestellen? Und wenn sich die Nachfrage nach bestimmten Produkten wieder ändern sollte, lassen sich solche Entscheidungen dank des Echtzeitcharakters der Daten auch wieder revidieren.

Dem Thema Lagerhaltung nähern sich Unternehmen dank Advanced Analytics auch aus einer anderen Perspektive. Das klassische Spare Parts Management lässt sich mit neuen Tools deutlich effizienter gestalten. Unnötige Lagerhaltung verursacht hohe Kosten. Mithilfe der Analyse-Werkzeuge lässt sich sehr leicht identifizieren, welche Teile ewig liegen, von welchen zu viel auf Lager ist und ob Teile vielleicht an verschiedenen Orten unnötigerweise gleichzeitig gelagert werden. In der Praxis lässt sich manches Inventar so um bis zu 50 Prozent reduzieren.

Advanced Analytics bietet neben dieser Status-quo-Transparenz auch die Möglichkeit, sich mit Problemen zu beschäftigen, die in Zukunft auftreten könnten. Die Corona-Pandemie und die Verzögerungen in der Supply Chain haben verdeutlicht, wie heikel es um die Lieferkettensicherheit mancher Firmen bestellt ist. Advanced Analytics simuliert genau solche Extremsituationen und zeigt auf, welche Auswirkungen dies auf das eigene Netzwerk hat.

Welche alternativen Wege gibt es? Wie würde sich der Cash-Bedarf verändern? Welche Verzögerungsdauer würde drohen? All dies lässt sich durchspielen. Wenn die Ergebnisse zeigen, dass es eng wird, dann sorgen Einkäufer:innen dank dieser Simulationen vor und entwickeln Notfallpläne.

Wichtig ist bei all diesen Anwendungsfällen, dass Unternehmen diese Tools nicht einmal installieren und es dann dabei belassen.

Regelmäßige Weiterentwicklung und Professionalisierung sind notwendig. Für die Verantwortlichen wird es darum gehen, die wachsenden Möglichkeiten im Auge zu behalten, aber gleichzeitig nicht vor lauter Begeisterung jede Gelegenheit zu ergreifen, weitere Daten einzuspeisen. Denn mehr bedeutet auch hier nicht immer besser. Die Daten müssen Relevanz für die Unternehmensziele haben und auf die Einkaufsziele einzahlen. Wenn die Mitarbeiter:innen sich eingearbeitet haben und mit den neuen Tools vertraut sind, können die anfangs moderaten Ziele auch durchaus ein wenig ambitionierter werden.

Advanced Analytics bietet eine Vielzahl von Anwendungsmöglichkeiten

- Einzelhandel

- Industriegüter

- Verpackung

- Automobilindustrie

- Pharmazeutika

- Potenzialanalyse

- Umsetzungsphase

- Ausschreibungsvorbereitung

- Unterstützung bei den Verhandlungen

- Direkte Aufgaben

- Indirekte Aufgaben

- Hilfsmittel

- Reinigung

- Verpackung

- Instandhaltung

- Logistik

- IT

- MRD

- Lebensmittel und Getränke

- Fashion

- Rechnungen

- Bestellungen

- Verkaufsdaten

- Vorräte

- Sendungen

- Servicekarten

- Projektmanagement-Daten

- Transportkosten

- Produktionsmengen

- Verbrauchsmengen

- Spend Cube & Analyse

- Service Level Optimierung

- Zahlungsoptimierung

- Maverick Buying

- Routenanalyse

- Produktionsportfolioanalyse

- Margenanalyse

- Sollkosten-Analyse

- Projektmanagement

Experten über digitale Transformation

Nicht im Elfenbeinturm einschließen

Oleksandr Vodotyka, MBA, ist seit 2016 Head of Procurement and Supply bei Coca Cola Hellenic Bottling Company und verantwortlich für den österreichischen Markt sowie die Service Center der Gruppe. Neben den operativen Einkaufsprozessen in seinen Business Units treibt er aktiv die digitale Transformation des Einkaufs voran. Einige Initiativen waren so erfolgreich, dass sie auch in vielen anderen Ländern umgesetzt wurden. Im Interview erklärt er, wie weit das Unternehmen damit schon gekommen ist – und warum technologieunterstützte, standardisierte Prozesse so wichtig sind.

Herr Vodotyka, Sie haben die digitale Transformation im Einkauf bei Coca Cola Hellenic maßgeblich mit vorangetrieben. Wie kam es dazu?

Den Auslöser für die Umstellung des Beschaffungswesens gaben 2015 unser CPO und das Leadership Team, das mich auch ins Unternehmen geholt hat. Wir hatten es uns unternehmensweit zum Ziel gesetzt, die Ausgaben zu optimieren, enger mit unseren Stakeholdern zusammenzuarbeiten sowie unsere Lieferkette agiler und resilienter zu gestalten. Wir wollten einheitliche Standards einführen. Uns war klar, dass wir diese strategischen Ziele nur Hand in Hand mit einem optimierten und digitalisierten Einkauf erreichen können.

Der Anstoß für Ihre Transformation liegt damit nun schon sechs Jahre zurück. Wie weit sind Sie mit dem Programm bereits gekommen?

Jede Transformation hat zwar einen konkreten Startpunkt, aber ein Ende gibt es wohl nie. Unser Programm hatte drei Phasen. In der ersten ging es uns darum, Transparenz über all unsere Ausgaben zu schaffen. Außerdem haben wir die strategische Entscheidung getroffen, dass der Einkauf für jeden Euro, der das Unternehmen verlässt, verantwortlich ist. Denn bis dahin waren die Fachabteilungen selbst für die Verhandlungen und Vertragsausgestaltungen verantwortlich. Dazu war es wichtig, die konkreten Bedürfnisse zu definieren, neue Wege in der Zusammenarbeit zu finden und dadurch ein neues Servicelevel innerhalb der Organisation zu schaffen.

Worum ging es in der zweiten und dritten Phase?

Die zweite Phase war wohl die herausforderndste. Wir mussten unser operatives Betriebsmodell komplett neu definieren, es ging um schlankere Prozesse, eine angepasste Organisationsstruktur und natürlich um den Einsatz neuer Technologien. In einigen Fällen ging es lediglich darum, dass wir die Einkaufstools, die wir bereits im Unternehmen hatten, besser in unsere alltäglichen Prozesse integrieren mussten, um von deren vollem Potenzial zu profitieren.

In der dritten Phase, in der wir uns inzwischen befinden, geht es darum, diese Transformation immer weiter voranzutreiben. Wir wollen weiterhin, wo immer möglich, Prozesse automatisieren. Ein wichtiger Meilenstein bei der Automatisierung wird beispielsweise eine einfach zu bedienende source-to-pay Plattform sein, mit der wir einen genauen Überblick über alle Einkaufsaktivitäten in allen Ländern haben, inklusive aller vor- und nachgelagerten Aktivitäten. Wir definieren auch unser Tail Spend Management neu, indem wir unseren Fachabteilungen integrierte Lösungen für eine einfachere Auftragsverwaltung über interne und externe Kataloge und Marktplätze anbieten. Dies führt zu neuen und spannenden Erfahrungen für die Kolleg:innen und verschafft dem Einkauf mehr Raum für strategische Initiativen und kontinuierliche Verbesserungen mit unseren Lieferanten.

Die Corona-Krise hat viele Unternehmen auf eine harte Probe gestellt. Wie robust hat sich der Einkauf von Coca Cola Hellenic inmitten seiner Transformation gezeigt?

Die Pandemie war ein Crashtest für unser Optimierungsprogramm. An vielen Punkten konnten wir sehen, dass wir bereits gut aufgestellt sind, in einigen gab es aber auch Verbesserungsbedarf. Wir konnten zum Beispiel dank der zuvor eingeführten Notfallmaßnahmen die Produktion in Österreich während der kompletten Krise aufrechterhalten. Die Situation hat dazu geführt, dass wir bei vielen Themen schnelle Entscheidungen treffen mussten. Im April 2020, als die Pandemie ihren ersten Höhepunkt erreichte, haben wir sehr kurzfristig auf elektronische Unterschriften bei allen internen und externen Dokumenten umgestellt, damit unser Geschäft reibungslos weiterlaufen konnte.

Was war die bisher größte Herausforderung während der Transformation?

Ich habe gelernt, dass man sich nicht in seinen Elfenbeinturm zurückziehen darf, um alleine einen Plan aufzustellen. Man kann die beste Strategie entwickelt haben und gute Analysen parat halten, aber solange man sich nicht den anderen Abteilungen abstimmt, erreicht man niemals die angestrebte Exzellenz.

Wir mussten ganz zu Beginn alle Stakeholder überzeugen, dass wir ein Umdenken brauchen und dass ein professionell aufgestellter Einkauf einen großen Wert haben kann. Wir haben mehrere, disziplinübergreifend Workshops für alle Ausgabenbereiche organisiert. Wir wollten alle Talente zusammenbringen, um die besten Lösungen in den Bereichen Kosten, Leistungen und Umsetzungsgeschwindigkeit zu finden. Entscheidend war es, die funktionale Expertise der Fachabteilungen mit dem Know-how der Data Analysten zu kombinieren. Strukturierte Daten und Modelle haben uns geholfen, Business Cases für die betreffenden Abteilungen aufzubauen, zu diskutieren und fundierte Entscheidungen zu treffen. Es gab einen detaillierten Projektplan, nach dem wir vorgegangen sind, klare Verantwortlichkeiten und festgelegte Timelines. Die komplexen Initiativen haben wir zunächst in einem kleineren Rahmen pilotiert, bevor wir sie im kompletten Umfang mit allen Funktionalitäten ausgerollt haben.

Welche Rolle spielte Ihr Einkaufsteam?

Unserem Procurement-Team kam wohl eine der entscheidendsten Rollen zu. Die Abteilung haben wir gerade zu Beginn zu einem Labor entwickelt, in dem wir neue Herangehensweisen, Best Practices, Methoden und Tools ausprobiert haben. Das war möglich, weil wir viele engagierte und enthusiastische Kolleg:innen hatten, die bei den Pilotprojekten mitmachen und diese weiter vorantreiben wollten. Es war außerdem wichtig, alle während der Umstellung möglichst eng mitzunehmen und ihre Fähigkeiten zu verbessern. Jetzt sind sie umso stolzer, dass der Einkauf komplett auf die Bedürfnisse unseres Unternehmens abgestimmt ist. Sie fühlen sich nun regelrecht als Wertschöpfungstreiber und haben dazu beigetragen, neue organisatorische Fähigkeiten zu schaffen und somit die Zusammenarbeit mit unseren internen Stakeholdern zu optimieren.

Sie haben in den vergangen Jahren viel Energie in die Transformation gesteckt. War es das wert?

Ja, unbedingt. Wir sind uns nun genau darüber im Klaren, welche strategische, welche taktische und welche operative Rolle der Einkauf im Unternehmen spielt. Es ist uns gelungen, unsere Prozesse abteilungsübergreifend zu standardisieren, egal in welcher Abteilung, wir bestellen nun immer nach der gleichen Vorgehensweise. Neue Arbeitsweisen und Source-to-Pay-Prozesse, die durch moderne Technologien unterstützt werden, bieten mehr Möglichkeiten für die Entwicklung unserer internationalen Talente an verschiedenen Standorten. So hat beispielsweise unsere neue Leiterin des Beschaffungssupports in Österreich, die für das effektive System, die Prozesse, die Einhaltung der Vorschriften und die Analysen zuständig ist, ihre Karriere in unserem Beschaffungsservicezentrum in Bulgarien begonnen.

Ich hoffe, dass wir in Zukunft noch mehr solcher Beispiele auf unserem Weg zur funktionalen Exzellenz erleben werden!

Organisationen haben ein Datenkomplexitätsproblem

Peter Jeitschko ist seit über 20 Jahren in verschiedenen IT Consulting und Sales Positionen tätig. Er arbeitete bei Volvo Cars, IBM, Oracle und dem Datenspezialisten Datameer. Aktuell ist er Solutions Sales Specialist und KI-Experte bei Microsoft Österreich.

Herr Jeitschko, Big Data ist seit Jahren im Trend. Ist es mittlerweile mehr als nur ein Buzzword?

Es ist sicherlich mehr als ein Buzzword. Allerdings impliziert „Big“, dass es sich um große Datenvolumina handelt. Die meisten Unternehmen haben aber kein Volumenproblem, sondern ein Datenkomplexitätsproblem. Aus diesem Grund ist der Begriff „Big Data“ in den allermeisten Fällen irreführend.

Was bedeutet das konkret?

Firmen haben meist keine zentrale Datenhaltung sondern viele verschiedene Datenquellen in unterschiedlichen Formaten, aus denen es gilt, Mehrwert für Organisationen zu generieren. Das sind nicht zwangsweise riesige Datenmengen. Um diesen Datenschatz zu heben, sind Datenqualität, skalierbare Datenplattformen und benutzerfreundliche Analysewerkzeuge essenziell.

Das wird sich künftig kaum ändern?

Das ist richtig, denn es kommen immer neue Datenformate dazu. In vielen Fällen sind es Audio- oder Videofiles, die es gilt, mit strukturierten Informationen aus Datenbanken zu kombinieren. Zu den hauseigenen On-Premise Datenbanken kommen dann noch Cloudanwendungen hinzu. Dies erhöht wiederum die Komplexität der Datenintegration und Datenanalyse.

Könnten neue Technologien wie Machine Learning und Künstliche Intelligenz helfen?

Wir sehen klar, dass der Trend in diese Richtung geht. Die Konzepte hinter Machine Learning und KI sind ja nicht neu, sondern basieren auf Überlegungen, die teils aus den 1970er und 1980er Jahren stammen. Was sich verändert hat, sind die Rechnerleistung und der Preis für die Verarbeitung von Daten. Das ermöglicht heutzutage neue Chancen: So kann man mittels KI und den richtigen analytischen Werkzeugen Maschinengeräusche analysieren und frühzeitig erkennen, wann eine Maschine ausfällt. Diese Anwendungsfälle fallen in die Kategorie „Predictive Maintenance“. Andere Use Cases bei Bild- und Videoerkennung gehen in Richtung Sicherheit. Beispielsweise kann man mittels KI automatisiert erkennen, ob jemand an einer Tankstelle raucht oder ob jemand auf einer Baustelle entsprechende Sicherheitskleidung trägt, um ggf. Alarm auszulösen. Künftig werden wir immer mehr solcher Anwendungsfälle sehen.

Welchen Organisationen fällt es besonders schwer mit komplexen Daten umzugehen?

Ich durfte Projekte bei börsennotierten Konzernen wie auch kleinen Mittelständlern und Startups begleiten. Bei Datenprojekten spielt die Größe einer Organisation eine untergeordnete Rolle bei der Bewältigung von Datenkomplexität. Es gibt aber kulturelle Unterschiede beim Umgang mit Daten. In angloamerikanischen Gebieten findet ein anderer Umgang mit Daten statt als beispielsweise in Österreich, Deutschland oder der Schweiz. Der berechtigte Wunsch nach Datenschutz wird gerne als Ausrede verwendet, um Datenprojekte erst gar nicht anzugehen. Besonders jene Organisationen, die teilweise Jahrzehnte in den Aufbau ihrer IT Infrastruktur investiert haben, leiden heute unter „digitalen Altlasten“. Im Banken- und Versicherungssektor beispielsweise findet man nicht selten Systeme vor, die vor 40 Jahren eingeführt wurden. Es muss aber klar sein: Die Aufgaben von heute lassen sich nicht mit den Methoden und der Infrastruktur von 1970 lösen. Andere Branchen wie Retail, Telekom und Logistik haben dies bereits erkannt und nehmen hier eine Vorreiterrolle ein.

Wie lassen sich Probleme mit solchen Altlasten lösen?

Wichtig ist, dass Organisationen eine Digitalisierungsstrategie haben. Davon abgeleitet auch eine Datenstrategie. Diese Strategie muss vom Topmanagement getragen und getrieben werden und beispielsweise von einem „Center of Excellence“ konsequent umgesetzt werden. Das bedeutet auch: Ich muss Altbekanntes über Bord werfen und setze IT Strukturen womöglich völlig neu auf. Das ist aus Risikogesichtspunkten aber nicht in jedem Fall möglich und so ist es wichtig, dass sich neue Technologien im Cloud Bereich in die bestehende IT Infrastruktur möglichst gut integrieren und einander ergänzen. Diese Hybrid Cloud Anwendungsszenarien werden uns noch lange Zeit begleiten.

Was raten Sie Organisationen, wenn Sie Datenprojekte angehen?

Es bringt nichts, aufwendig eine Dateninfrastruktur aufzubauen, wenn sie am Ende das jeweilige Problem nicht löst. Es braucht also zuerst eine konkret definierte Problem- oder Fragestellung, dann eine Lösungsidee und erst danach die einzelnen technischen Komponenten, um den jeweiligen Anwendungsfall sinnstiftend lösen zu können.

Woran scheitern heute noch die meisten Datenprojekte?

Datenprojekte scheitern aus zwei wesentlichen Gründen: Der Erste ist das entsprechende Skillset der eigenen Mitarbeiter:innen. Das Management muss verstehen, welche Möglichkeiten digitale Geschäftsmodelle bieten und Mitarbeiter:innen die Möglichkeit geben, sich gezielt weiterzubilden. Microsoft unterstützt Organisationen in diesem Bereich beispielsweise mit der „Enterprise Skills Initiative“ – einem individuell auf die Organisationsbedürfnisse zugeschnittenen Aus- und Weiterbildungsprogramm.

Und der zweite Grund?

Der zweite Grund ist eine fehlende Digitalisierungsstrategie oder eine, die nur auf dem Papier existiert und im Unternehmen nicht gelebt wird. Es ist essenziell, dass die Mitarbeiter:innen einer Organisation bei der Umsetzung der Strategie eng eingebunden werden. Wichtig dabei ist zu bedenken, dass Digitalisierungs- und Datenprojekte keine reinen IT Projekte sind. Die jeweiligen Fachexpert:innen aus den Business Abteilungen müssen eng mit ihren IT Kolleg:innen und Spezialist:innen wie z. B. Data Scientists zusammenarbeiten. Anderenfalls sind Datenprojekte erfahrungsgemäß zum Scheitern verurteilt.